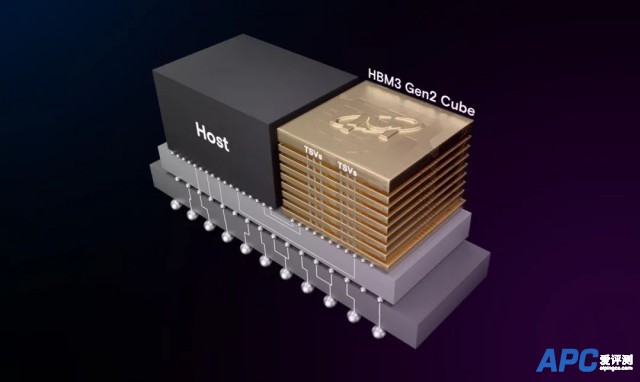

[aipingce]7月28日消息,Micron Technology Inc.(美光科技股份有限公司)今日宣布,公司已开始出样业界首款 8 层堆叠的 24GB 容量第二代 HBM3 内存,其带宽超过 1.2TB/s,引脚速率超过 9.2Gb/s,比当前市面上现有的 HBM3 解决方案性能可提升最高 50%。美光第二代 HBM3 产品与前一代产品相比,每瓦性能提高 2.5 倍,创下了关键型人工智能(AI)数据中心性能、容量和能效指标的新纪录,将助力业界缩短大型语言模型(如 GPT-4 及更高版本)的训练时间,为 AI 推理提供高效的基础设施,并降低总体拥有成本(TCO)。  美光基于业界前沿的 1β DRAM 制程节点推出高带宽内存(HBM)解决方案,将 24Gb DRAM 裸片封装进行业标准尺寸的 8 层堆叠模块中。此外,美光 12 层堆叠的 36GB 容量产品也将于 2024 年第一季度开始出样。与当前市面上其他的 8 层堆叠解决方案相比,美光 HBM3 解决方案的容量提升了 50%。美光第二代 HBM3 产品的性能功耗比和引脚速度的提升对于管理当今 AI 数据中心的极端功耗需求至关重要。美光通过技术革新实现了能效的显著提升,例如与业界其他 HBM3 解决方案相比,美光将硅通孔(TSV)数量翻倍,增加 5 倍金属密度以降低热阻,以及设计更为节能的数据通路。  美光作为 2.5D/3D 堆叠和先进封装技术领域长久以来的存储领导厂商,有幸成为台积电 3DFabric 联盟的合作伙伴成员,共同构建半导体和系统创新的未来。在第二代 HBM3 产品开发过程中,美光与台积电携手合作,为 AI 及高性能计算(HPC)设计应用中顺利引入和集成计算系统奠定了基础。台积电目前已收到美光第二代 HBM3 内存样片,正与美光密切合作进行下一步的评估和测试,助力客户的下一代高性能计算应用创新。 美光第二代 HBM3 解决方案满足了生成式 AI 领域对多模态、数万亿参数 AI 模型日益增长的需求。凭借高达 24GB 的单模块容量和超过 9.2Gb/s 的引脚速率,美光 HBM3 能使大型语言模型的训练时间缩短 30% 以上,从而降低总体拥有成本。此外,美光 HBM3 将触发每日查询量的显著增加,从而更有效地利用训练过的模型。美光第二代 HBM3 内存拥有业界一流的每瓦性能,将切实推动现代 AI 数据中心节省运营开支。在已经部署的 1,000 万个图形处理器(GPU)用例中,单个 HBM 模块可节约 5W 功耗,能在五年内节省高达 5.5 亿美元的运营费用。 美光副总裁暨计算与网络事业部计算产品事业群总经理 Praveen Vaidyanathan 表示:“美光第二代 HBM3 解决方案旨在为客户及业界提供卓越的人工智能和高性能计算解决方案。我们的一个重要考量标准是,该产品在客户平台上是否易于集成。美光 HBM3 具有完全可编程的内存内建自测试(MBIST)功能,可在完整规格的引脚速度下运行,使美光能为客户提供更强大的测试能力,实现高效协作,助力客户缩短产品上市时间。” 英伟达超大规模和高性能计算副总裁 Ian Buck 表示:“生成式 AI 的核心是加速计算,HBM 的高带宽至关重要,并带来更出色的能效。我们与美光在众多产品领域保持了长期合作,非常期待与美光在第二代 HBM3 产品上继续合作,加速 AI 创新。” 第二代 HBM3 是美光领先技术的又一个里程碑。美光此前宣布推出基于 1α(1-alpha)节点、24Gb 单块 DRAM 裸片的 96GB 容量 DDR5 模组用于大容量服务器解决方案;如今推出基于 1β 节点、24Gb 单块 DRAM 裸片的 24GB 容量 HBM3 产品,并计划于 2024 年上半年推出基于 1β 节点、32Gb 单块 DRAM 裸片的 128GB 容量 DDR5 模组。这些新品展现了美光在 AI 服务器领域的前沿技术创新。 |